電子產品包裝材料的性能分析與測試

隨著電子技術的飛速發展,電子元器件廣泛應用于消費電子、通信設備、工業控制等領域。電子元器件在運輸、儲存過程中易受外部環境因素影響,如沖擊、振動、濕度、靜電等,因此包裝材料的性能至關重要。本文針對電子產品包裝材料的性能要求進行分析,并探討相關測試方法。

一、包裝材料的性能要求

電子產品包裝材料需具備以下關鍵性能:

- 防靜電性能:電子元器件對靜電敏感,包裝材料需具備抗靜電或導電特性,防止靜電放電(ESD)損壞器件。常見材料包括防靜電塑料袋、導電泡沫等。

- 緩沖性能:材料應能有效吸收沖擊和振動能量,保護元器件免受物理損傷。例如,發泡聚乙烯(EPE)、聚氨酯泡沫等具有良好的緩沖效果。

- 防潮性能:濕度可能導致元器件腐蝕或短路,因此包裝材料需具有低透濕性,如鋁箔復合膜、防潮袋等。

- 耐溫性:在極端溫度環境下,材料應保持穩定性,避免變形或性能退化。

- 環保性:隨著環保法規的加強,可降解或可回收材料(如紙質包裝、生物基塑料)的應用日益重要。

二、性能測試方法

為確保包裝材料的可靠性,需進行系統測試:

- 靜電測試:通過表面電阻測試儀測量材料的電阻值,評估其防靜電等級。依據標準如IEC 61340-5-1,確保材料能有效消散靜電荷。

- 緩沖測試:使用沖擊測試機(如跌落測試)和振動臺模擬運輸環境,評估材料對沖擊和振動的吸收能力。參考ASTM D4169等標準,測試后檢查元器件是否完好。

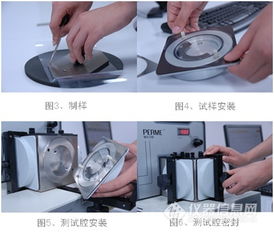

- 防潮測試:將材料置于高濕環境中(如恒溫恒濕箱),測量其透濕率(WVTR)。依據標準如ASTM E96,確保材料能有效阻隔水分。

- 溫度測試:通過高低溫循環試驗,檢驗材料在-40°C至85°C范圍的性能變化,包括尺寸穩定性和機械強度。

- 環保測試:進行可降解性測試(如ISO 14855)和毒性分析,確保材料符合RoHS等環保法規。

三、應用實例與趨勢

以智能手機主板包裝為例,常采用防靜電泡沫與鋁箔袋組合,通過上述測試確保運輸安全。隨著電子產品小型化和綠色化趨勢,包裝材料將向輕量化、智能感知(如濕度指示)和可持續方向發展。

電子產品包裝材料的性能分析與測試是保障電子元器件質量的關鍵環節。企業應結合具體應用場景,選擇合適材料并嚴格執行測試標準,以提升產品可靠性和市場競爭力。

如若轉載,請注明出處:http://www.perfectshares.cn/product/31.html

更新時間:2026-04-14 11:47:09